DeepSeek-V4全系API同步开放,百万上下文全员标配,双模型架构重新定义开源上限

2026年4月24日,DeepSeek 正式推出DeepSeek-V4 预览版并全面开源上线。不同于以往常规版本迭代,这一代模型完成了全方位体系化升级,将百万级超长上下文、高阶逻辑推理、成熟智能体能力与开源部署优势深度融合。

依托双版本差异化架构设计,DeepSeek-V4 打破能力壁垒,进一步缩小开源模型与顶级闭源产品的差距,为开发者、企业及科研场景,打造适配全链路生产需求的通用AI底座。

双模型并行布局,精准覆盖全场景需求

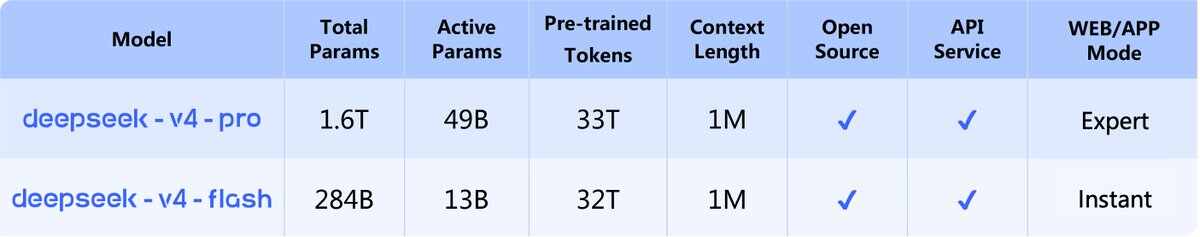

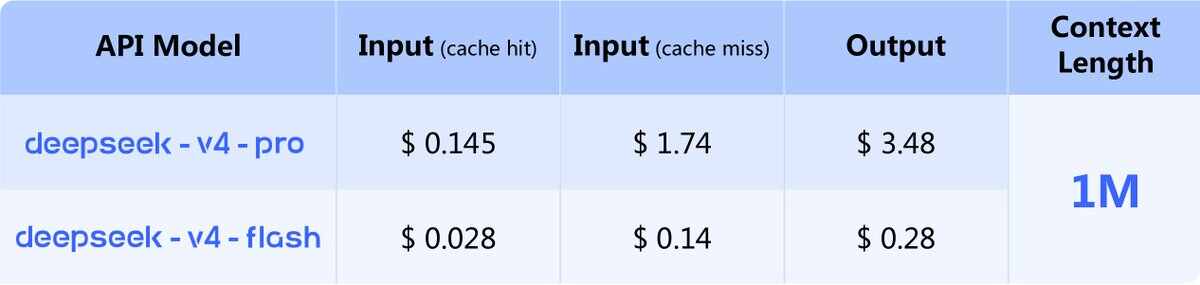

本次发布的DeepSeek-V4系列包含两大核心型号,定位清晰、优势互补,均将1M token超长上下文设为默认配置,彻底打破“长上下文高门槛”的行业困境。

-

DeepSeek-V4-Pro

总参数1.6T、激活参数49B,定位旗舰级高性能模型。主打复杂逻辑推演、仓库级代码开发、长链路智能体任务、专业科研分析等高阶场景,综合实力对标全球一线闭源大模型,是重度生产力需求的核心选择。 -

DeepSeek-V4-Flash

总参数284B、激活参数13B,主打轻量化、低延迟、高性价比。日常对话、轻量化代码编写、普通文档处理等基础场景表现稳定,简单智能体任务体验与旗舰版相差无几,API调用成本更低,适配中小企业与个人开发者高频使用需求。

两种版本互补搭配,让高端算力攻坚与轻量化普惠使用不再割裂,也让开源模型的商业化落地路径更加清晰。

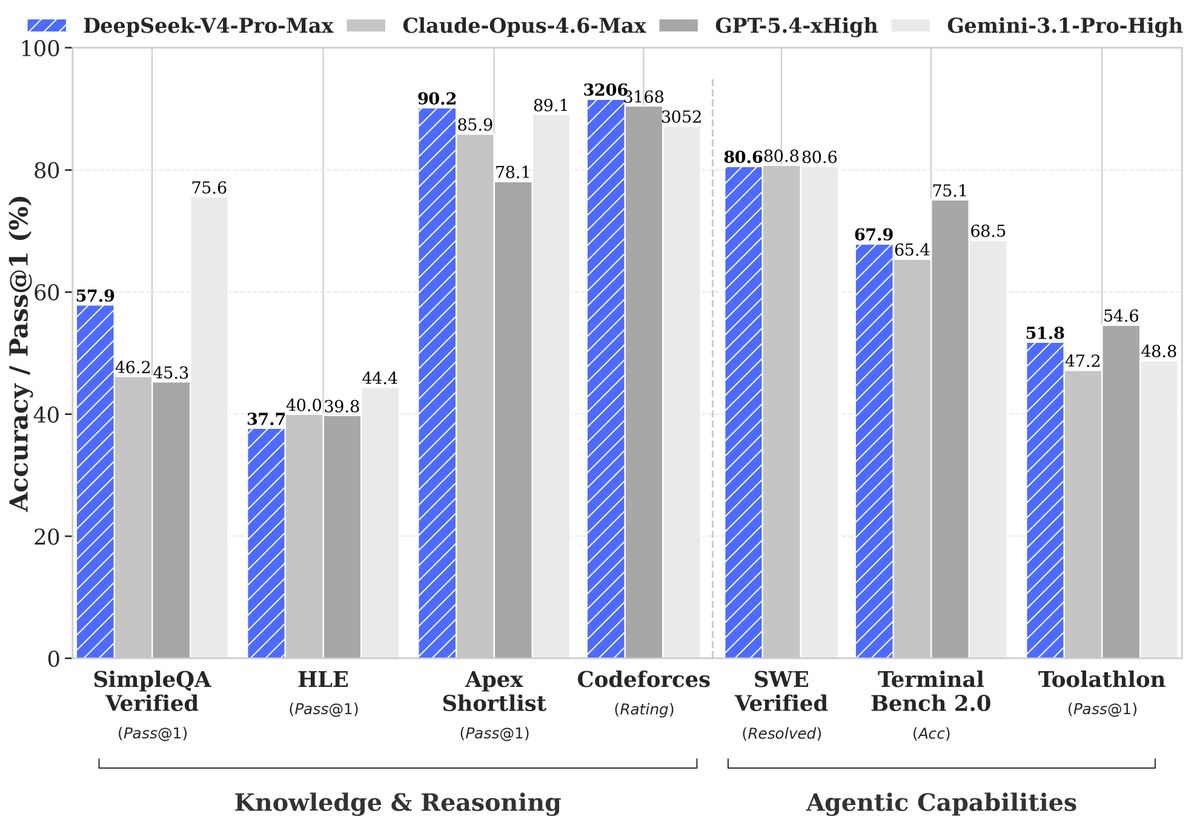

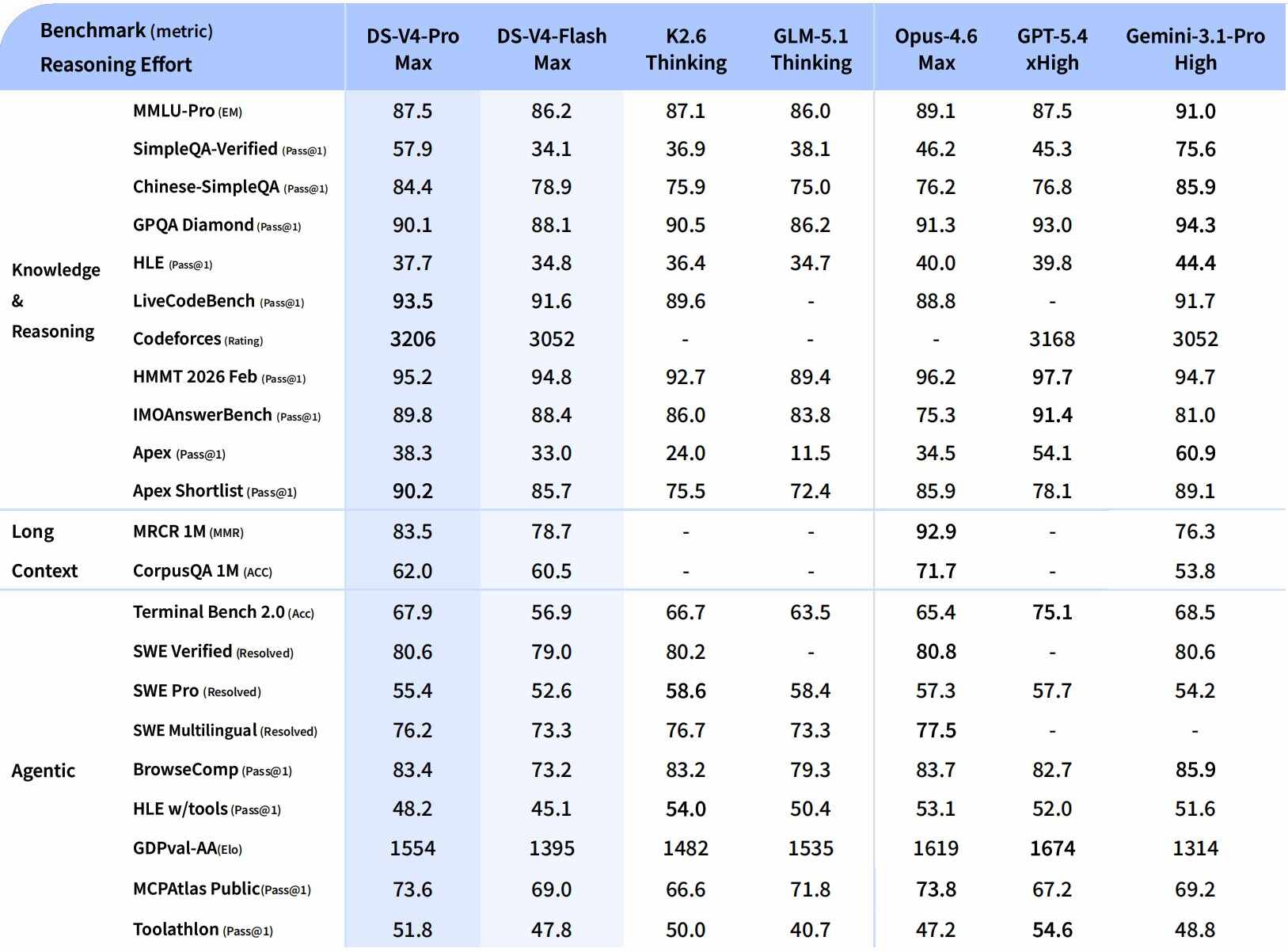

🔹 DeepSeek-V4-Pro:旗舰级性能,比肩顶级闭源

作为系列旗舰型号,V4-Pro搭载1.6T总参数、49B激活参数,官方明确其性能可与全球顶级闭源模型抗衡,核心优势集中在三大维度:

- Agent能力升级:在Agentic Coding基准测试中达到开源领域SOTA( state-of-the-art)水准,成为开源模型中的佼佼者;

- 知识储备雄厚:在现有开源模型中表现领先,仅落后于Google Gemini-3.1-Pro,知识覆盖广度与准确性实现大幅提升;

- 推理实力顶尖:在数学、STEM学科、编程等硬核场景中,超越所有当前开源模型,性能逼近顶级闭源产品。

🔹 DeepSeek-V4-Flash:轻量高效,高性价比之选

针对轻量化、高吞吐场景,V4-Flash以284B总参数、13B激活参数打造,兼顾性能与成本,核心亮点的如下:

- 推理能力接近V4-Pro,日常简单任务可实现同等体验;

- 简单Agent任务表现与旗舰版持平,无需为基础需求支付高额成本;

- 参数规模更小,响应速度更快,API调用成本更具优势,适配个人开发者与中小企业高频使用场景。

架构创新:让1M上下文从“可用”到“好用”

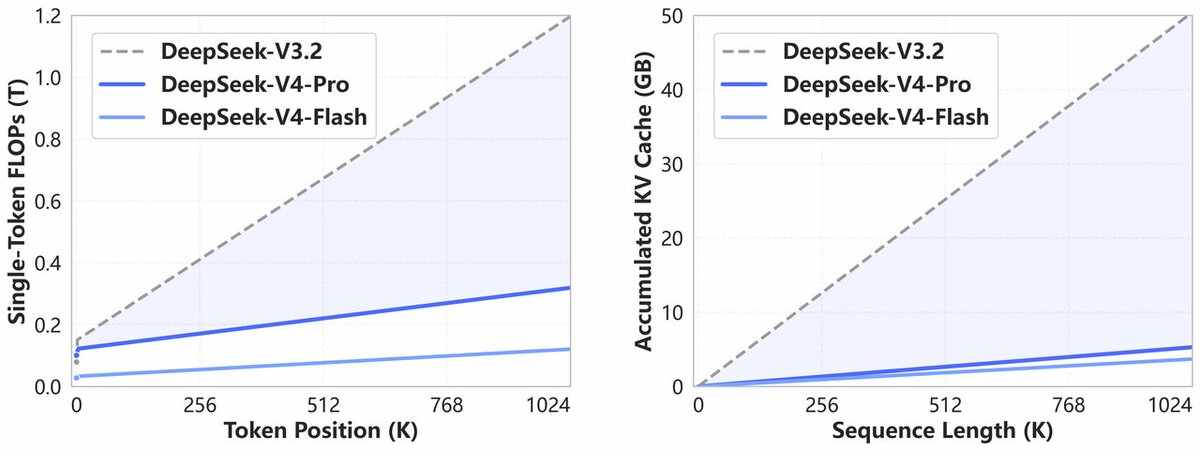

🔹 架构创新:让1M上下文从“可用”到“好用”

DeepSeek-V4最具突破性的升级,在于通过结构创新实现长上下文的高效落地,彻底解决传统长上下文模型“算力消耗高、显存占用大”的痛点。

官方披露,V4采用全新注意力机制,将token级压缩技术与DeepSeek稀疏注意力(DSA)深度结合,实现了世界领先的长上下文效率——在大幅降低计算成本与内存消耗的同时,将1M token上下文设为全系默认配置,让百万字长文本处理、整库代码阅读等场景成为常态。

🔹 Agent能力专项优化,深度融入生产工作流

为强化模型的实际落地价值,DeepSeek-V4针对Agent能力进行专项打磨,不仅实现了与Claude Code、OpenClaw、OpenCode等主流AI Agent的无缝集成,更已在DeepSeek内部投入使用,成为团队Agentic Coding的核心工具。

官方还展示了V4-Pro生成的PDF示例,直观呈现其在文档生成等Agent相关任务中的出色表现,印证了模型从“能对话”到“能干活”的跨越。

🔹API今日上线,无缝迁移+双推理模式适配

伴随模型发布,DeepSeek-V4全系API同步开放,开发者可轻松接入,核心优势如下:

- 接入便捷:无需修改base_url,仅需将model参数更新为“deepseek-v4-pro”或“deepseek-v4-flash”即可调用;

- 接口兼容:支持OpenAI ChatCompletions与Anthropic两大主流API规范,降低现有项目迁移成本;

- 双模式支持:两大模型均原生支持1M上下文,同时搭载思考模式(Thinking)与非思考模式(Non-Thinking),可根据任务难度灵活切换。

其中,思考模式可通过两种方式开启:一是将model参数设为“deepseek-reasoner”,二是在请求中设置“thinking: {"type": "enabled"}”(使用OpenAI SDK时需放入extra_body中)。该模式下,模型会先输出思维链推理(reasoning_content),再给出最终答案,大幅提升复杂任务的响应准确性,同时支持工具调用、多轮对话等功能,适配高阶开发需求。

官方特别提醒,旧版模型“deepseek-chat”后续将逐步停用,开发者需及时更新参数,完成版本迁移。

总结:开源大模型的又一次跨越式前进

DeepSeek-V4的发布,不仅是一次常规版本迭代,更是开源模型向“高性能、高性价比、高可用性”迈进的重要一步。双模型布局覆盖不同需求,架构创新解决长上下文痛点,Agent能力适配生产场景,再加上便捷的API接入与开源开放的定位,让更多开发者能够低成本使用顶级开源模型的核心能力。

从1M上下文普惠,到Agent能力比肩闭源,DeepSeek-V4正在打破开源与闭源模型的能力鸿沟,为2026年AI开发与产业落地注入全新动力。